La inteligencia artificial (IA) ha revolucionado la forma en que vivimos y trabajamos, ofreciendo soluciones que van desde la automatización de procesos hasta la toma de decisiones complejas en diversas industrias. Sin embargo, uno de los retos más críticos que enfrentan los desarrolladores y científicos de datos es el sesgo en la IA, un problema que puede traducirse en discriminación y resultados injustos. En este artículo, profundizaremos en qué es el sesgo en la IA, sus orígenes, las consecuencias de su presencia en los modelos y, sobre todo, las estrategias y buenas prácticas que pueden adoptarse para evitarlo. Este recorrido informativo pretende ser un recurso valioso tanto para profesionales del área como para interesados en comprender mejor los desafíos éticos y técnicos que plantea la implementación de la inteligencia artificial.

Entendiendo el sesgo en la IA

El sesgo en la IA se refiere a la inclinación o predisposición que puede tener un algoritmo para favorecer ciertos resultados o grupos de datos en detrimento de otros. Este fenómeno puede originarse en diversas etapas del desarrollo del modelo, desde la recopilación de datos hasta la interpretación final de los resultados. Es importante destacar que la presencia de sesgo no siempre es intencional, sino que puede derivar de prácticas poco rigurosas en la selección y preparación de los datos, o de la replicación de prejuicios existentes en la sociedad.

Uno de los aspectos clave es que los algoritmos aprenden de datos históricos, y si estos contienen patrones de discriminación, es probable que el modelo los perpetúe. Por ejemplo, si un sistema de selección de personal se entrena con datos de contrataciones pasadas que estuvieron sesgados por género o etnia, el algoritmo puede reproducir esas mismas tendencias discriminatorias en sus decisiones futuras.

Orígenes del sesgo en la Inteligencia Artificial

1. Calidad y representatividad de los datos

Una de las principales fuentes de sesgo radica en la calidad y diversidad de los datos utilizados. Cuando los conjuntos de datos no representan adecuadamente la variedad de la población o contienen errores, el modelo tiende a favorecer aquellos patrones que predominan en la muestra. Esto es especialmente problemático en áreas como la salud, la educación y el empleo, donde la diversidad es crucial para la toma de decisiones justas y equilibradas.

Tip: Es fundamental realizar una evaluación exhaustiva de los datos, asegurándose de que sean representativos y estén libres de errores sistemáticos. La limpieza y la normalización de los datos son pasos esenciales antes de entrenar cualquier modelo.

2. Selección de características y variables

La elección de las variables o características que se alimentan en el modelo también puede introducir sesgo. Si se incluyen variables que históricamente han estado asociadas a criterios discriminatorios, se corre el riesgo de que el modelo aprenda patrones injustos. Por ejemplo, utilizar variables socioeconómicas sin un análisis profundo puede llevar a que el sistema clasifique de manera desfavorable a ciertos grupos.

Consejo: Realizar un análisis de impacto ético de cada variable puede ayudar a identificar aquellas que puedan resultar problemáticas. Se debe optar por la inclusión de características que aporten valor predictivo sin comprometer la equidad.

3. Diseño y arquitectura del modelo

La arquitectura del algoritmo y las decisiones de diseño en su desarrollo pueden amplificar sesgos existentes. Algunos modelos, por su naturaleza, pueden tener mayor predisposición a sobreajustar ciertos patrones, lo que resulta en una menor capacidad para generalizar a nuevos casos o poblaciones. La elección entre modelos simples y complejos debe balancear la precisión con la transparencia y la interpretabilidad.

Cosas a evitar:

- No depender únicamente de modelos “caja negra” sin mecanismos de validación explicativa.

- Evitar la sobreoptimización de parámetros que podrían reforzar sesgos preexistentes en los datos.

Impacto del sesgo en la sociedad y en la toma de decisiones

El sesgo en la IA no es un problema puramente técnico; tiene implicaciones sociales profundas. Los sistemas automatizados se utilizan cada vez más para tomar decisiones críticas, como la aprobación de créditos, la asignación de recursos en el ámbito sanitario o incluso la evaluación en procesos judiciales. Cuando estos sistemas están sesgados, las consecuencias pueden ser devastadoras para las personas afectadas, generando desigualdades y discriminación institucionalizada.

Ejemplos Reales de Impacto

- Sector financiero: Algoritmos de scoring crediticio que penalizan a grupos minoritarios debido a patrones históricos de exclusión.

- Recursos humanos: Sistemas de selección de personal que reproducen sesgos de género o etnia, afectando la diversidad en el lugar de trabajo.

- Justicia penal: Herramientas predictivas que pueden contribuir a la sobre-representación de ciertos grupos en el sistema penitenciario.

Estos ejemplos evidencian la necesidad imperiosa de abordar el sesgo en la IA con rigor ético y técnico, implementando controles y auditorías constantes en el desarrollo y despliegue de estos sistemas.

El sesgo en la IA no es un problema puramente técnico; tiene implicaciones sociales profundas. Los sistemas automatizados se utilizan cada vez más para tomar decisiones críticas, como la aprobación de créditos, la asignación de recursos en el ámbito sanitario o incluso la evaluación en procesos judiciales.

Estrategias y buenas prácticas para evitar la discriminación

1. Diversificación y balanceo de datos

Una estrategia crucial es garantizar que los datos utilizados sean diversos y equilibrados. Esto implica:

- Recopilación de datos inclusivos: Asegurarse de que la muestra incluya representaciones de todos los grupos relevantes.

- Técnicas de balanceo: Emplear métodos como sobremuestreo o submuestreo para corregir desbalances en los conjuntos de datos.

2. Auditorías y evaluaciones éticas continuas

Realizar auditorías periódicas es esencial para detectar y corregir sesgos en los modelos. Estas auditorías deben incluir:

- Revisión de variables: Evaluar constantemente las características utilizadas para asegurarse de que no introduzcan sesgos.

- Evaluación de impacto: Medir cómo las decisiones del modelo afectan a diferentes grupos de manera diferencial.

3. Transparencia y “explicabilidad” del modelo

La transparencia en los procesos de modelado y la capacidad de explicar las decisiones del algoritmo son fundamentales para construir confianza y detectar sesgos. Herramientas de interpretabilidad, como LIME o SHAP, pueden ayudar a:

- Desentrañar el razonamiento detrás de las predicciones.

- Permitir a los desarrolladores y usuarios identificar rápidamente cualquier sesgo o comportamiento inesperado.

Tip: Documentar cada paso del desarrollo del modelo, desde la selección de datos hasta la evaluación final, crea una trazabilidad que facilita la identificación y corrección de posibles sesgos.

4. Colaboración Interdisciplinaria

La colaboración entre expertos en tecnología, ética, sociología y derecho es esencial para abordar el problema del sesgo de manera integral. Esta colaboración puede dar lugar a:

- Normativas y estándares: Desarrollo de protocolos y guías de mejores prácticas para la creación de modelos justos.

- Investigación conjunta: Iniciativas de investigación que unan diversas disciplinas para explorar nuevas metodologías en la mitigación del sesgo.

Consejos y recomendaciones prácticas

Para quienes se encuentran en el proceso de diseñar y desarrollar modelos de IA, aquí se presentan algunos consejos prácticos:

- Revisa la procedencia de tus datos: Antes de entrenar cualquier modelo, investiga el origen de los datos y su representatividad. Una base de datos sesgada puede comprometer todo el proceso.

- Implementa pruebas de equidad: Durante la fase de validación del modelo, incluye métricas que evalúen la equidad en las predicciones, asegurándote de que no existan disparidades significativas entre grupos.

- Actualiza y reentrena el modelo periódicamente: Los contextos sociales y económicos cambian, y lo que era representativo en un momento puede no serlo en otro. Mantén tus modelos actualizados para reflejar las nuevas realidades.

- Fomenta la retroalimentación de usuarios: Permite que los usuarios finales den su opinión sobre el desempeño del modelo. Esta retroalimentación puede ser crucial para detectar comportamientos inesperados o injustos.

- Utiliza herramientas de interpretabilidad: No subestimes la importancia de entender cómo y por qué tu modelo toma ciertas decisiones. Herramientas que facilitan la interpretación pueden ser clave para identificar y corregir sesgos ocultos.

Consejo final: La prevención del sesgo no es una tarea única, sino un proceso continuo de revisión, ajuste y aprendizaje. La ética en la inteligencia artificial debe estar siempre presente en cada etapa del desarrollo.

Conclusión

El sesgo en la inteligencia artificial es un desafío multifacético que requiere una atención constante y un enfoque multidisciplinario. Al mejorar la calidad y diversidad de los datos, implementar auditorías éticas, fomentar la transparencia y capacitar a los equipos de trabajo, es posible minimizar la discriminación en los modelos de IA. Adoptar estas buenas prácticas no solo mejora la precisión y efectividad de los algoritmos, sino que también contribuye a construir una sociedad más justa e inclusiva.

Si te apasiona la tecnología y deseas profundizar en el mundo de la IA, te invitamos a inscribirte en nuestro bootcamp «Data IA: Data Science + Deep Learning con IA» y a explorar nuestro curso «IA Lab Smart Work». Estas formaciones te brindarán las herramientas necesarias para enfrentar los retos éticos y técnicos de la inteligencia artificial, y te ayudarán a convertirte en un profesional comprometido con la innovación responsable.

¡Da el siguiente paso en tu carrera y forma parte de la revolución de la IA responsable!

Explora cómo podemos ayudarte en la formación en tecnología

Artículos relacionados

7 consejos para empezar Ciberseguridad en 2025 – Parte 1

¿Cómo empezar en Ciberseguridad? ¿Por qué la Ciberseguridad es una trayectoria profesional prometedora en 2025? El panorama digital actual se expande a un ritmo sin precedentes, y con él, la necesidad crítica de proteger nuestros datos, sistemas y redes. En este...

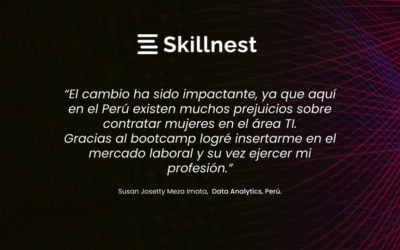

Mi proceso fue muy enriquecedor – Susan Josetty Meza Imata

En esta entrada de blog queremos compartir el testimonio de Susan Josetty Meza Imata, graduada de nuestro bootcamp Data Analytics, originaria de Perú. Su historia es un reflejo del compromiso y la pasión por aprender, demostrando que con dedicación es posible...

Cinco claves para que los estudiantes aprovechen al máximo las últimas semanas de práctica profesional — El Mercurio

Lunes, 17 de febrero 2025